Google Gemini 是一款非常强大的 AI 对话系统,只要输入提示词,就能在短短几秒内生成流畅自然的回复。Gemini 都能提供令人惊叹的智能协助,极大地提高了人类的工作效率和创造力。

本文档主要介绍 Gemini Chat Completion API 操作的使用流程,利用它我们可以轻松使用官方 Gemini 的对话功能。

申请流程

要使用 Gemini Chat Completion API,首先可以到 Gemini Chat Completion API 页面点击「Acquire」按钮,获取请求所需要的凭证:

如果你尚未登录或注册,会自动跳转到登录页面邀请您来注册和登录,登录注册之后会自动返回当前页面。

在首次申请时会有免费额度赠送,可以免费使用该 API。

基本使用

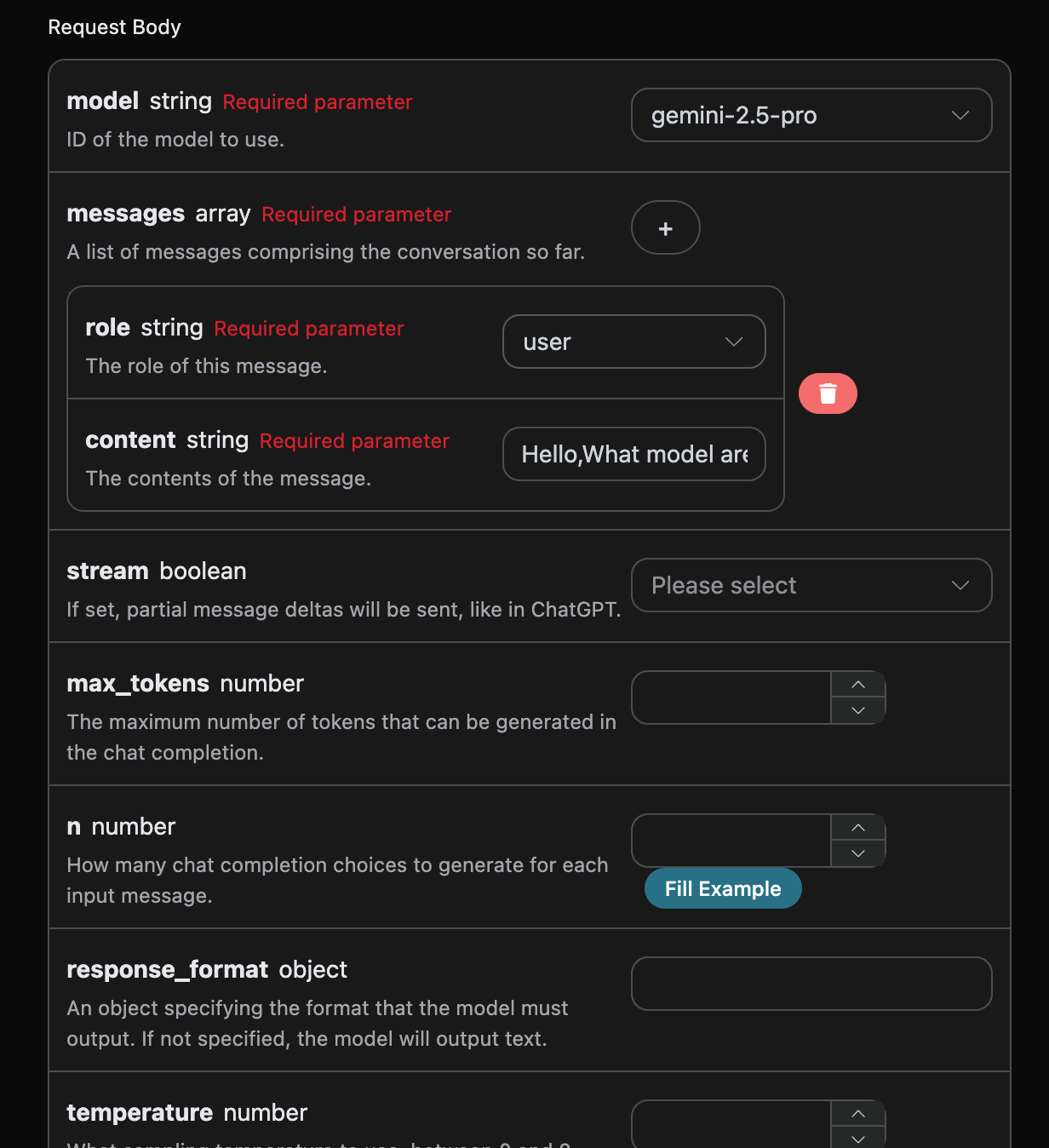

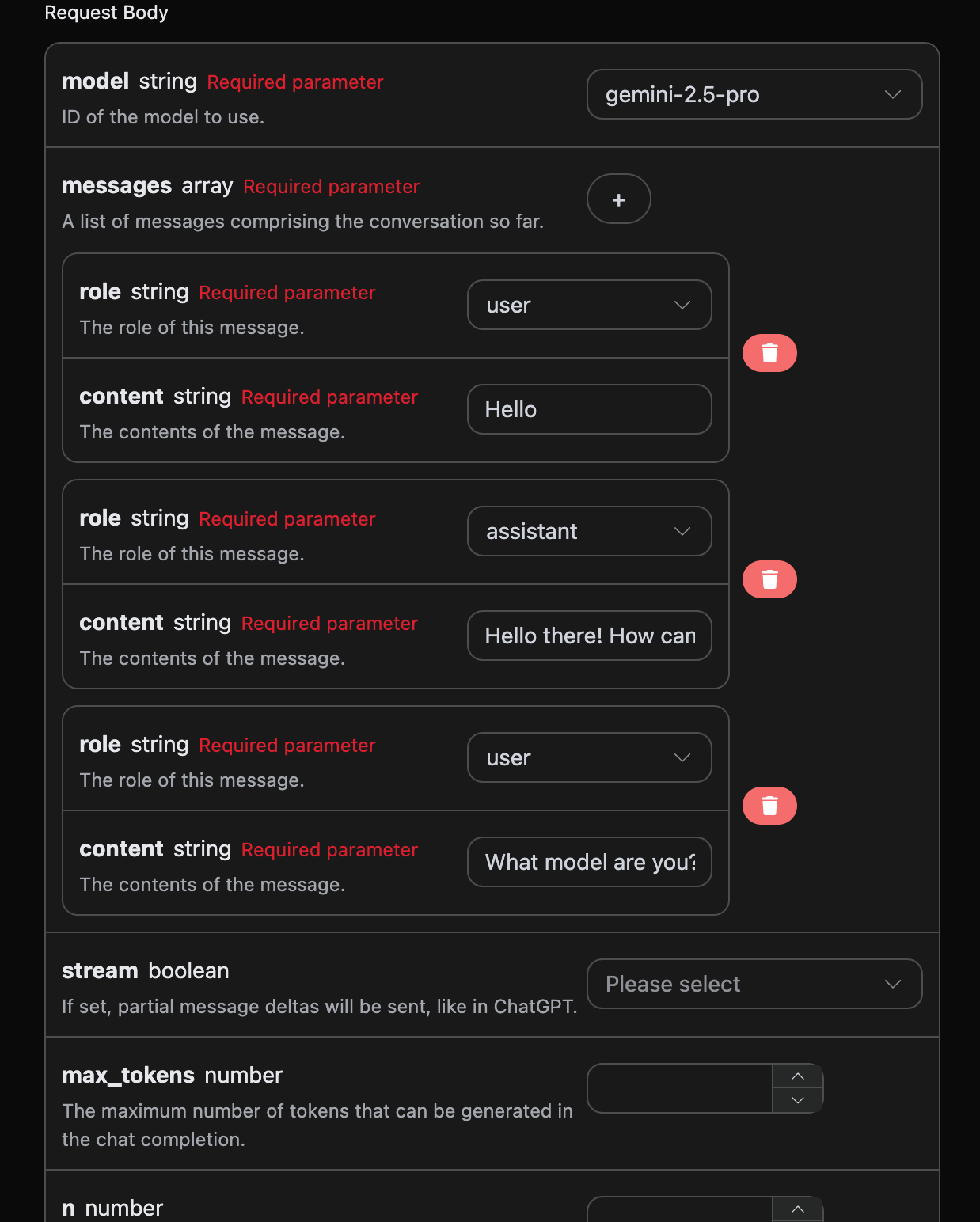

接下来就可以在界面上填写对应的内容,如图所示:

在第一次使用该接口时,我们至少需要填写三个内容,一个是 authorization,直接在下拉列表里面选择即可。另一个参数是 model, model 就是我们选择使用 Gemini 官网模型类别,这里我们主要有 6 种模型,详情可以看我们提供的模型。最后一个参数是messages,messages是我们输入的提问词数组,它是一个数组,表示可以同时上传多个提问词,每个提问词包含了 role 和 content,其中 role 表示提问者的角色,我们提供了三种身份,分别为 user 、assistant、system 。另一个 content 就是我们提问的具体内容。

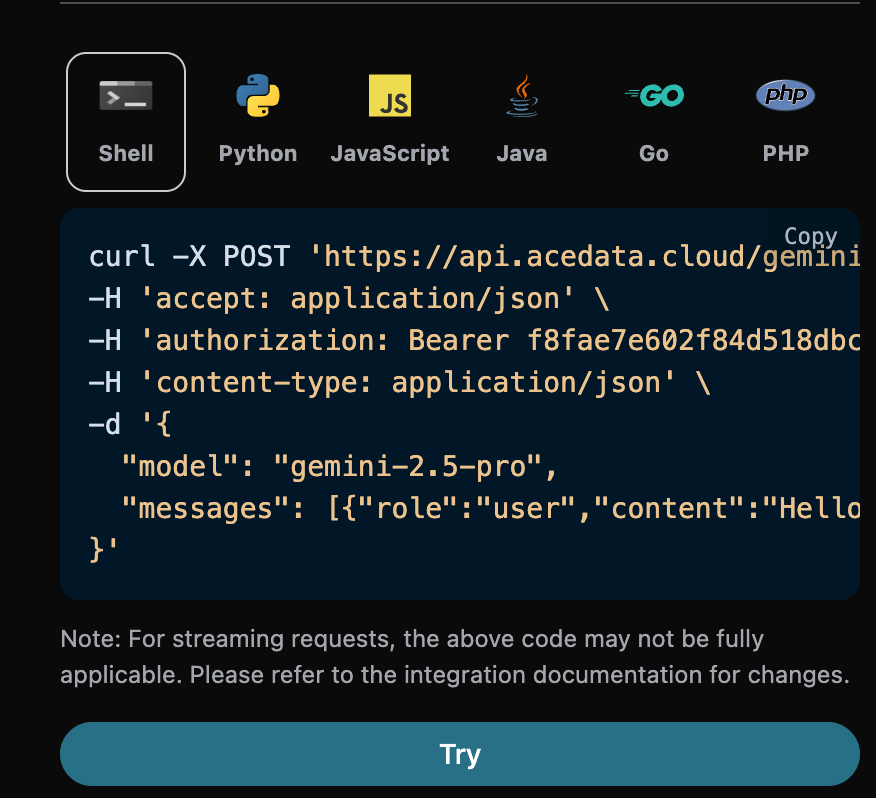

同时您可以注意到右侧有对应的调用代码生成,您可以复制代码直接运行,也可以直接点击「Try」按钮进行测试。

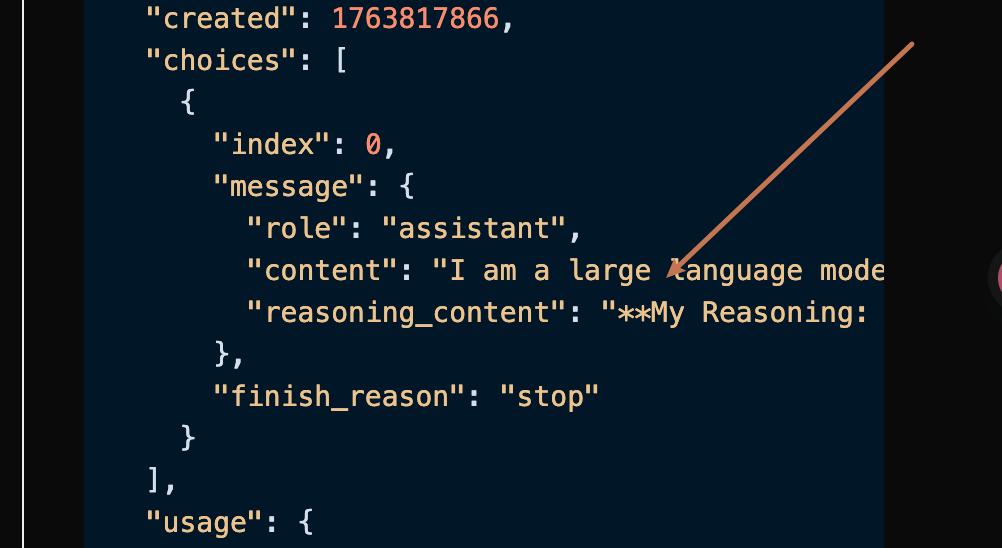

调用之后,我们发现返回结果如下:

1 |

{ |

返回结果一共有多个字段,介绍如下:

id,生成此次对话任务的 ID,用于唯一标识此次对话任务。model,选择的 Gemini 官网模型。choices,Gemini 针对提问词给于的回答信息。usage:针对本次问答对 token 的统计信息。

其中 choices 是包含了 Gemini 的回答信息,它里面的 choices 是 Gemini回答的具体信息,可以发现如图所示。

可以看到,choices 里面的 content 字段包含了 Gemini 回复的具体内容。

流式响应

该接口也支持流式响应,这对网页对接十分有用,可以让网页实现逐字显示效果。

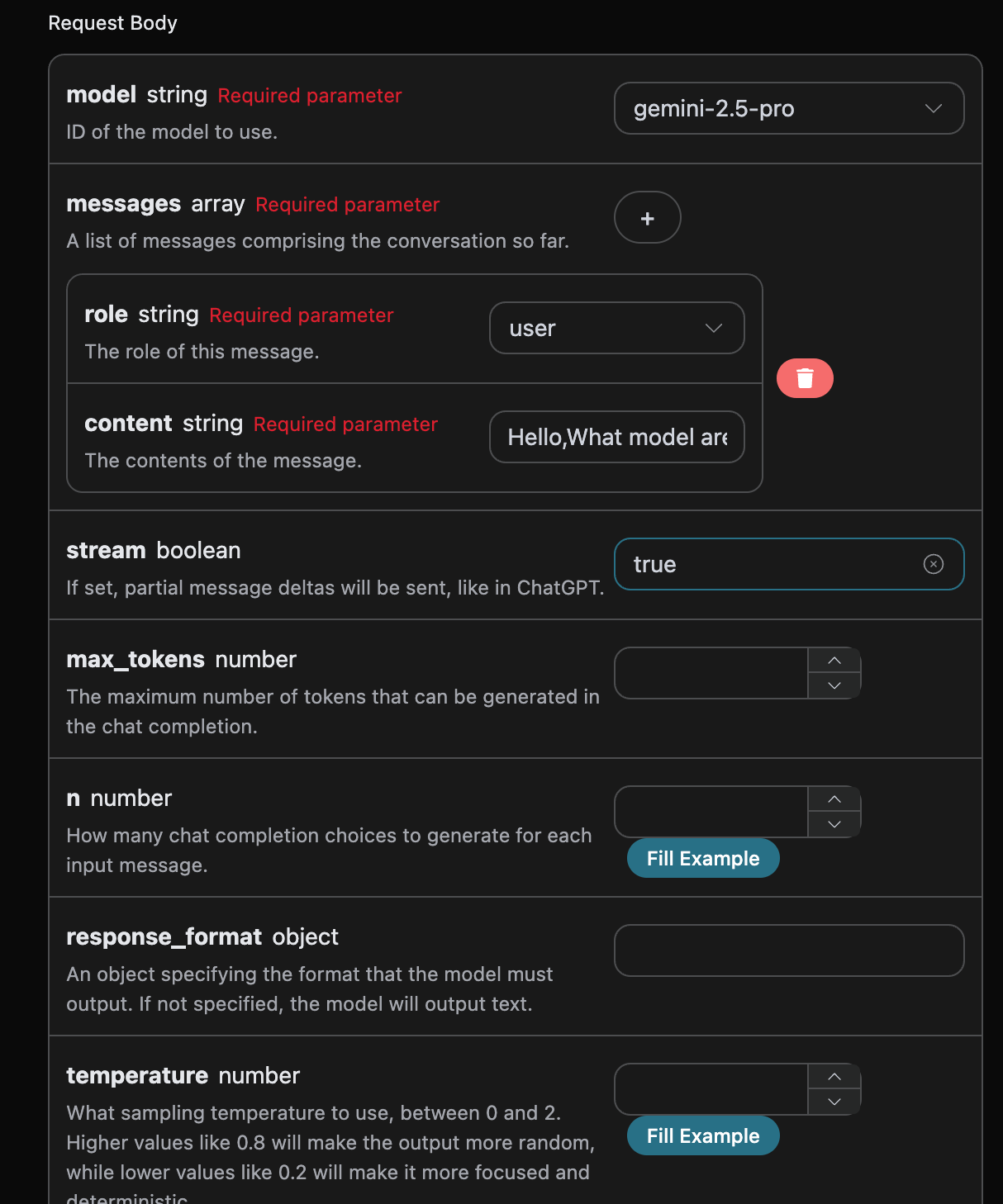

如果想流式返回响应,可以更改请求头里面的 stream 参数,修改为 true。

修改如图所示,不过调用代码需要有对应的更改才能支持流式响应。

将 stream 修改为 true 之后,API 将逐行返回对应的 JSON 数据,在代码层面我们需要做相应的修改来获得逐行的结果。

Python 样例调用代码:

1 |

import requests |

输出效果如下:

1 |

data: {"id": "chatcmpl-20251122214038810722821kNjUTjtr", "object": "chat.completion.chunk", "created": 1763818842, "model": "gemini-2.5-pro", "system_fingerprint": null, "choices": [{"delta": {"content": "", "role": "assistant"}, "logprobs": null, "finish_reason": null, "index": 0}], "usage": null} |

可以看到,响应里面有许多 data ,data 里面的 choices 即为最新的回答内容,与上文介绍的内容一致。choices 是新增的回答内容,您可以根据结果来对接到您的系统中。同时流式响应的结束是根据 data 的内容来判断的,如果内容为 [DONE],则表示流式响应回答已经全部结束。返回的 data 结果一共有多个字段,介绍如下:

id,生成此次对话任务的 ID,用于唯一标识此次对话任务。model,选择的 Gemini 官网模型。choices,Gemini 针对提问词给于的回答信息。

JavaScript 也是支持的,比如 Node.js 的流式调用代码如下:

1 |

const options = { |

Java 样例代码:

1 |

JSONObject jsonObject = new JSONObject(); |

其他语言可以另外自行改写,原理都是一样的。

多轮对话

如果您想要对接多轮对话功能,需要对 messages 字段上传多个提问词,多个提问词的具体示例如下图所示:

Python 样例调用代码:

1 |

import requests |

通过上传多个提问词,就可以轻松实现多轮对话,可以得到如下回答:

1 |

{ |

可以看到,choices 包含的信息与基本使用的内容是一致的,这个包含了 Gemini 针对多个对话进行回复的具体内容,这样就可以根据多个对话内容来回答对应的问题了。

Gemini-3.0 多模态模型

请求样例:

1 |

{ |

样例结果:

1 |

{ |

当然你也可以传如视频的链接,具体的输入如下:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

{

"model": "gemini-3.0-pro",

"messages": [

{

"role": "user",

"content": [

{

"type": "text",

"text": "视频的内容是什么?"

},

{

"type": "image_url",

"image_url": {

"url": "https://cdn.acedata.cloud/58yioe.mp4"

}

}

]

}

],

"stream": false

}

样例结果:

1 |

{ |

从上面可以看出是Gemini 3.0模型可以支持多模态的理解的。

错误处理

在调用 API 时,如果遇到错误,API 会返回相应的错误代码和信息。例如:

400 token_mismatched:Bad request, possibly due to missing or invalid parameters.400 api_not_implemented:Bad request, possibly due to missing or invalid parameters.401 invalid_token:Unauthorized, invalid or missing authorization token.429 too_many_requests:Too many requests, you have exceeded the rate limit.500 api_error:Internal server error, something went wrong on the server.

错误响应示例

1 |

{ |

结论

通过本文档,您已经了解了如何使用 Gemini Chat Completion API 轻松实现官方 Gemini 的对话功能。希望本文档能帮助您更好地对接和使用该 API。如有任何问题,请随时联系我们的技术支持团队。